易特驰:AI时代的网络安全

随着人工智能技术的飞速发展,网络安全领域正面临前所未有的挑战与变革。随着大语言模型和深度学习在攻击与防御端的应用,传统依赖人工的被动体系面临颠覆性挑战,而主动式AI防御虽展现出潜力,却仍受数据匮乏和法律边界制约。这一转型不仅影响汽车行业,更波及全球关键基础设施,亟需构建跨领域协同的新安全生态。

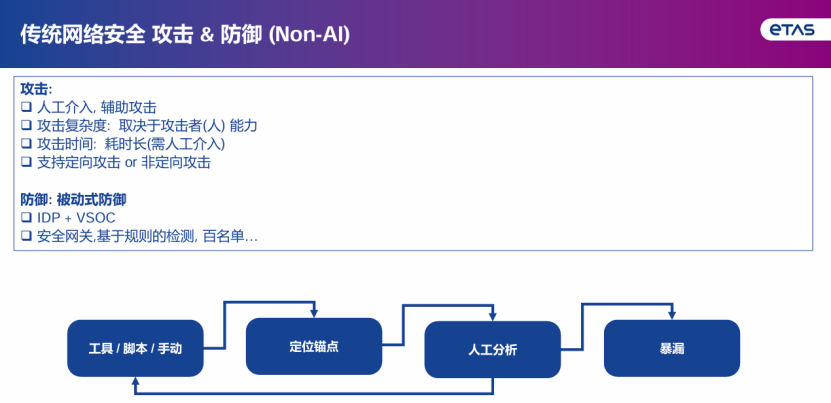

易特驰网络安全总监徐立解析传统网络安全攻防模式:攻击端依赖人为参与,耗时较长,支持定向/非定向攻击;防御端以被动式防御为主,如部署安全网关或基于规则的检测机制。

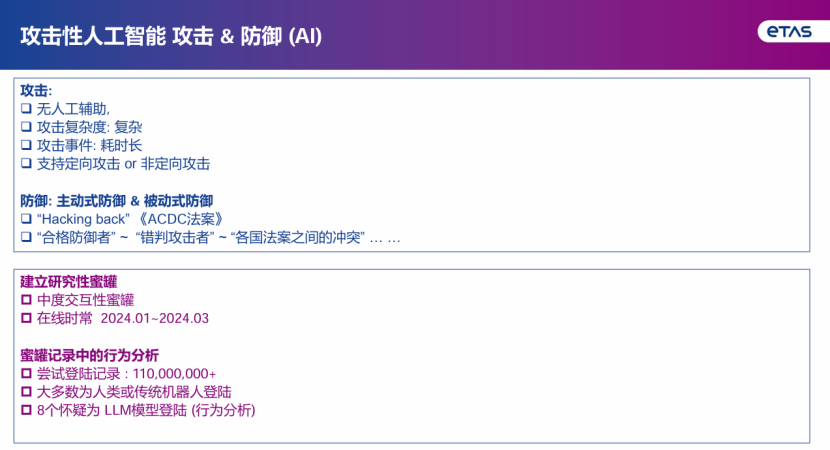

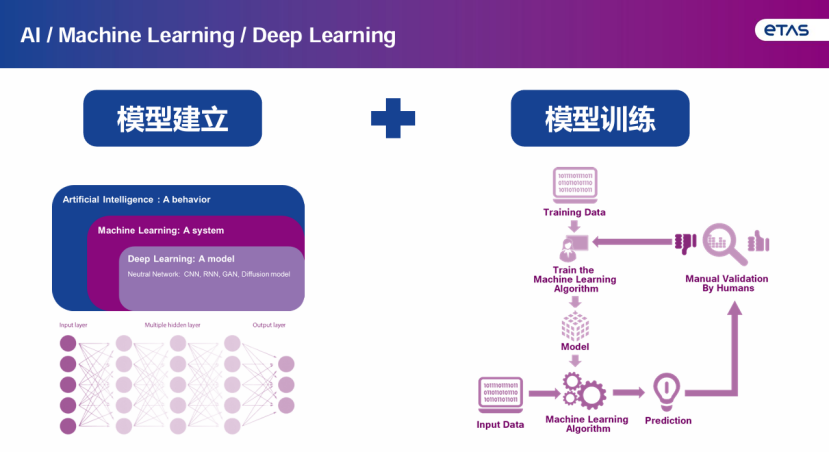

易特驰通过研究型蜜罐开展行为分析,数据显示蜜罐记录的尝试登陆次数超1.1亿次,多数为人类或传统机器人操作,其中8次疑似LLM模型登陆。当前AI网络攻击虽理想状态为全自动化,但实际复杂度尚未达标;防御端虽可尝试主动防御,却面临跨法律冲突导致反击受阻的困境。徐立指出,模型建立与训练是核心难点——大语言模型虽基于人类表述,在深度学习中的适用性仍存争议,却是当下最优选择,未来或向对抗网络形式演进。

徐 立 | 易特驰网络安全总监

以下为演讲内容整理:

传统网络安全攻防的固有局限

传统网络攻击高度依赖人工介入,攻击者需手动扫描系统开放端口、识别潜在锚点(如未修补的漏洞或薄弱接口),并反复调整策略以定位高价值资产,这一过程耗时漫长,攻击复杂度直接取决于攻击者的个人技能水平,且支持定向(针对特定目标如车企服务器)或非定向模式;防御端则普遍采用被动式机制,例如基于规则的入侵检测系统(IDS/IPS)监控异常流量、安全网关实施白名单或黑名单过滤,以及虚拟安全运营中心(VSOC)进行事后响应,这些手段无法预判或阻止威胁,导致在汽车电子电气架构等实时性场景中防护效率低下,难以应对突发性大规模攻击。

图源:演讲嘉宾素材

AI驱动的攻防模式根本性迁移

人工智能正在重构攻防逻辑,攻击端借助大语言模型(LLM)可自主执行全流程操作,包括漏洞扫描、密码破解(如自动识别并输入验证码)、行为隐匿(如清除攻击痕迹),大幅缩短攻击时间至秒级并提升复杂度至超越人类水平;防御端首次具备主动反击能力,例如通过“Hacking Back”机制直接溯源攻击源进行反制,但面临法律风险——美国《ACDC法案》草案对“合格防御者”定义模糊(如误判攻击者时的责任界定),且各国法律对跨境反击存在冲突(如攻击源位于不同司法辖区时的管辖权问题);

图源:演讲嘉宾素材

为实证AI攻击特征,该企业部署了中度交互型蜜罐系统,该系统模拟真实环境吸引攻击,记录超1.1亿次登录行为,通过行为模式分析(如响应速度异常快于人类操作、无视交互陷阱)识别出8次高度疑似LLM模型攻击,证实AI攻击已从理论转向实践威胁,对车联网等IoT设备构成直接风险。

图源:演讲嘉宾素材

深度学习落地的三重挑战

当前AI安全模型面临根本性瓶颈:首先,大语言模型(LLM)依赖自然语言训练数据,但网络攻防行为需多模态数据(如协议流量、二进制代码或图像特征),而开源数据集稀缺且标注困难,导致模型泛化能力不足;其次,监督学习需人工标注攻击特征(如有标签的数据集),但人工介入限制了模型自主性,而无监督学习虽能自主发现异常(如通过聚类分析),却因假阳性率高(误报率上升)难以实用化;其三,技术路径尚未统一,基于特征工程(Feature-based)的方案依赖专家经验定义规则,而端到端微调(Fine-tuning)需海量标记数据,且在生成对抗网络(GAN)应用中,通过攻防AI自主博弈(类似AlphaGo的自我进化)虽可衍生新策略,但训练过程不稳定,易陷入局部最优解。

图源:演讲嘉宾素材

博弈、合规与能力重构

AI重塑网络安全竞争本质,攻击方仅需一次成功即可突破防线(如单次漏洞利用),而防御方需持续零失误(长期监控与更新),这要求防御模型的准确率大幅提升且假阳性率趋近于零;技术爆发点将出现在数据质量与法律适配交叉领域,一方面需建立多模态网络行为数据库(整合协议、代码等),另一方面推动全球法律协同,明确AI防御的责任边界(如《ACDC法案》的跨境适用);当前各国能力差距显著,2022年评估显示美国网络安全综合排名第4(得分7.13),中国位列第12(得分6.27),但随着低代码AI工具普及,中小企业可通过云化安全服务快速补足资源短板,未来三年动态对抗式防御矩阵将成为智能汽车与工业物联网的核心支柱。

图源:演讲嘉宾素材

未来展望与挑战

网络安全攻防将演化为AI模型间的持续博弈,亟需解决数据采集瓶颈和法律框架缺失,同时提升模型准确率以应对攻击者只需一次成功的特性;全球协作是关键,否则能力差距可能导致新兴市场面临更高风险。

(以上内容来自于易特驰网络安全总监徐立于2025年6月19日在2025第四届中国车联网安全大会上进行的发表的《AI时代的网络安全》主题演讲。)

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。